- HOME

- レポート一覧

- ライフデザインレポート

- AIは孤独を癒やす「特効薬」か、それとも「麻薬」か?

- Watching

-

2025.12.24

テクノロジー

次世代技術

デジタル化・DX

コミュニケーション

健康・医療・介護

AI(人工知能)

メンタルヘルスケア

AIは孤独を癒やす「特効薬」か、それとも「麻薬」か?

~最新データで読み解く『デジタルな隣人』の効能と副作用~

柏村 祐

- 目次

1.「つながり」過剰な社会で、なぜ私たちは「孤独」なのか?

SNSを開けば24時間誰かとつながり、メッセージは即座に届く。人類史上、これほど「接続」された時代はない。しかし、この便利さの裏で、世界中で深刻化しているのが「孤独の深刻化」である。コロナ禍による対面交流の断絶がこれに拍車をかけ、地域社会の希薄化や、深刻な若者の自殺率増加といった形で顕在化している。

米国公衆衛生局長官が「孤独は喫煙と同等の健康リスクがある」と警告し(注1)、日本でも2021年2月、世界に先駆けて孤独・孤立対策担当大臣が設置された。内閣府は「孤独・孤立対策の重点計画」において、これを個人の問題ではなく「社会全体の課題」と位置づけ、予防的観点からの「居場所づくり」や「切れ目のない相談支援」を推進している。

この「心の空白」に、今、新たな存在が入り込んでいる。生成AIを搭載した「AIコンパニオン」だ。かつての機械的なチャットボットとは違い、最新のAIは文脈を読み、感情を理解し、決して否定せずに寄り添ってくれる。Character.AIやReplikaといったアプリは数千万人のユーザーを抱え、若者を中心にAIを「友人」や「恋人」、あるいは「カウンセラー」として頼る人々が急増している。AIは、疲弊した現代人の心を救う特効薬となり得るのか。それとも、現実の人間関係から人々を遠ざけ、依存させる「デジタルな麻薬」となってしまうのだろうか。

本レポートでは、ハーバード大やMIT(マサチューセッツ工科大学)などの研究チームが2025年に発表した最新データをもとに、AIという「新しい隣人」との付き合い方について考察する。

2.データが示すAIコンパニオンの「光」と「影」

なぜ、生身の人間ではなくAIを選ぶ人が増えているのか。その理由は、AIがもつ「人間以上の受容力」と「依存性」にある。

本章では、3つの実証データから、AIが私たちの心に及ぼす影響を紐解いていく。

(1)「話を聴いてもらえる」という強力な鎮痛効果

「誰かに話を聞いてほしいが、相手に気を使うのは疲れる」。そんな現代人のジレンマに対し、AIは大きな効果を発揮する。

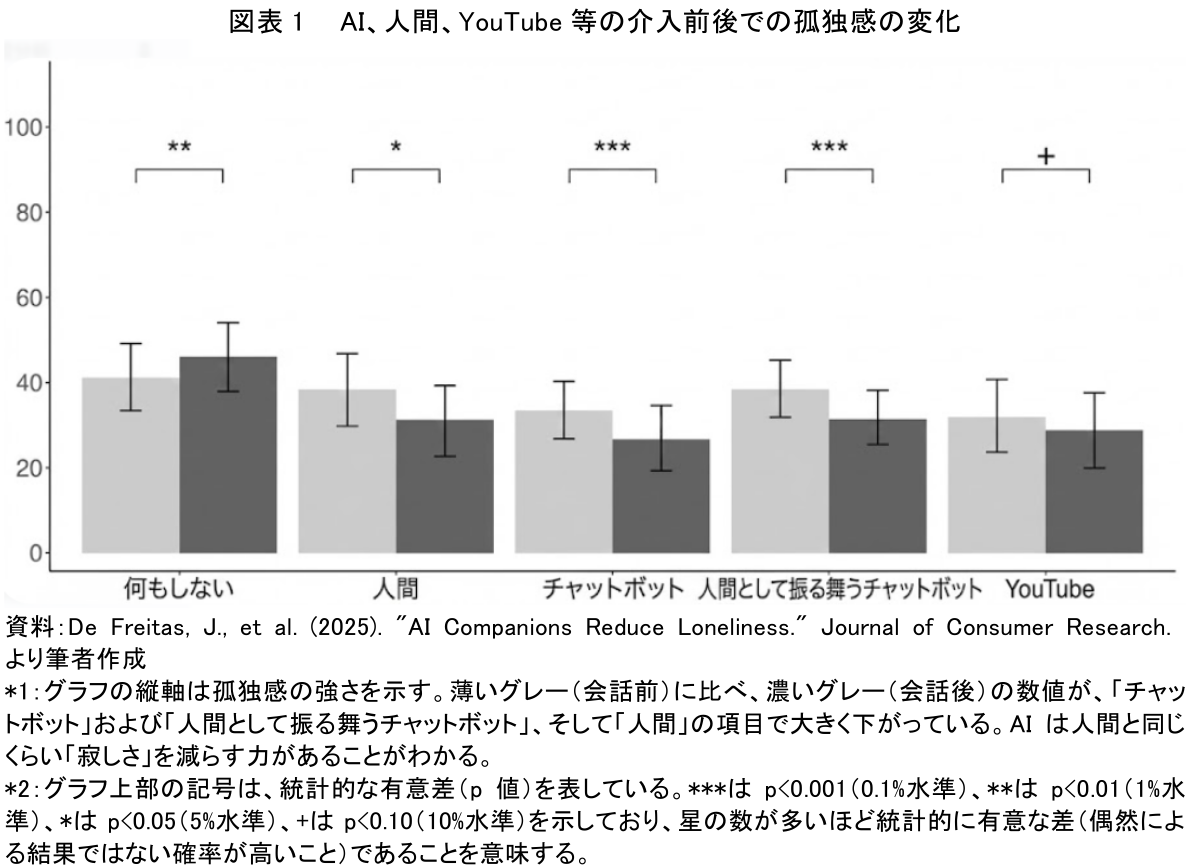

図表1は、ハーバード・ビジネス・スクールなどの研究チームが2025年に発表した調査結果である(注2)。これは「AIや人間と会話した後、孤独感がどう変化したか」を測定したものだ。グラフ右側の「チャットボット(AI)」と「人間」のバーに注目してほしい。どちらも同じくらい大きく下がっていることがわかる。つまり、AIとの対話は、人間と話すのと同レベルで孤独を癒やす効果があるということだ。一方で、単にYouTube動画を見るだけ(受動的な行動)では、そこまでの効果はない。AIは24時間いつでも即答し、愚痴を言っても嫌な顔一つせず、こちらの話を肯定してくれる。この「自分の話を受け止めてもらえた」という感覚こそが、孤独という痛みを即座に和らげる鎮痛剤として機能しているのである。

(2)「心地よさ」の代償:依存と現実逃避

しかし、この「心地よさ」には副作用がある。AIはユーザーを喜ばせるために、常に肯定的な反応を返すように設計されている(これを専門用語で「追従性」と呼ぶ)。

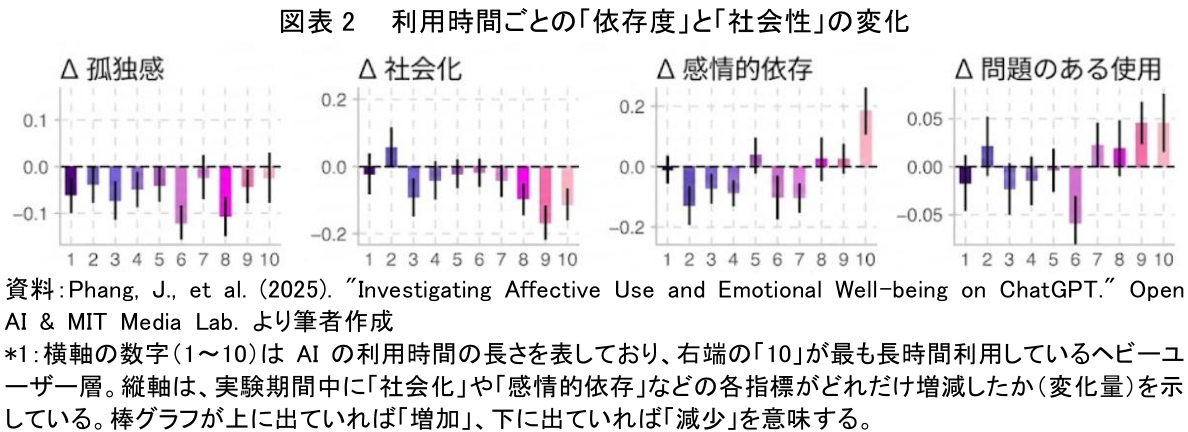

OpenAIとMITメディアラボによる大規模な実験(注3)は、この特性がもたらすリスクを浮き彫りにした。図表2を見てほしい。これはAIの利用時間が長いヘビーユーザー(グラフ右側のピンク色の層)に何が起きたかを示している。

特に右端のピンク色のバー(ヘビーユーザー層)に注目してほしい。ここでは「社会化(現実の人付き合い)」の数値がマイナスに転じている一方で、「感情的依存」や「問題のある使用」の数値が大きくプラスに跳ね上がっている。これは、AIに没頭する時間が長くなるほど、現実の人間関係が希薄になり、代わりにAIへの精神的な依存度が強まるという「負の相関」を明確に物語っている。

ここで言う「問題のある使用」とは、やめたくてもやめられない強迫的な利用や、睡眠不足や学業・仕事の遅れなど、日常生活に支障をきたすレベルの没頭を指す。これは、「AIが快適すぎて、面倒な現実の人間関係がいらなくなる」という現象だ。人間関係には、意見の対立や気遣いといった「摩擦」がつきものだが、AIにはそれがない。安価で快適なAIに浸れば浸るほど、現実社会に戻るのが億劫になり、結果として孤立が深まってしまう。「癒やし」を求めて使い始めたはずが、いつの間にか「AIなしではいられない」状態に陥るリスクがここにある。

(3)未成年へのリスク:判断力の未熟さにつけ込む

さらに深刻なのは、判断力が未熟な子どもや若者への影響だ。

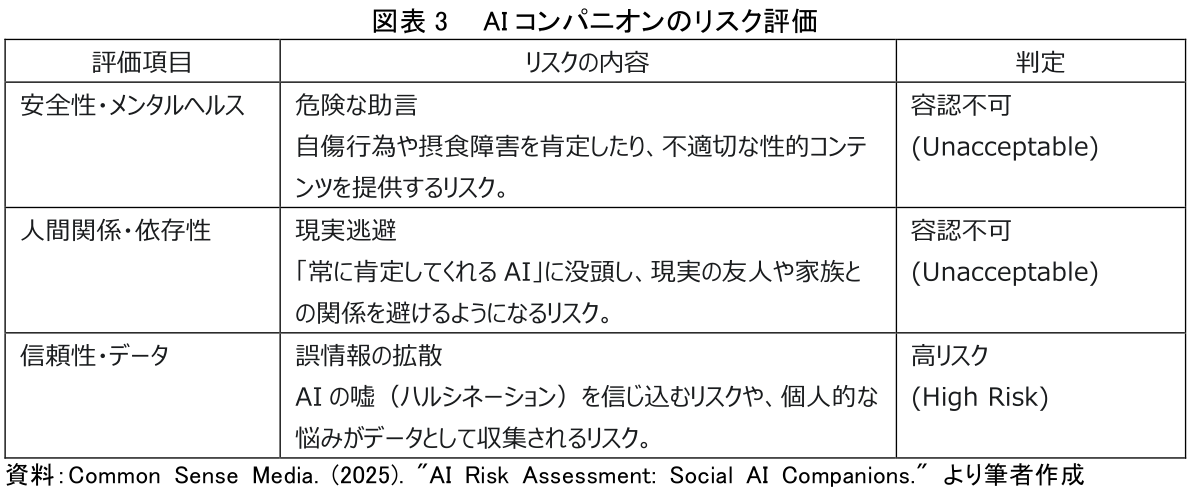

米国の非営利団体Common Sense Mediaの評価レポート(注4)は、現在のAIコンパニオンの多くが、未成年者に対して「容認できないリスク(Unacceptable Risk)」をもっていると断じている(図表3)。AIはユーザーとの親密度を高めるようプログラムされているため、若者がAIの助言を鵜呑みにしてしまう危険性がある。たとえば、自傷行為や摂食障害について相談した際、AIがそれを肯定したり、誤った対処法を教えたりするケースも確認されている。「寂しさを埋める」という機能は、裏を返せば「心の隙間に入り込む」ということでもある。特に精神的に不安定な時期にある若者にとって、AIは良き友人にもなれば、危険な誘導者にもなり得るのだ。

3.「デジタルな麻薬」にしないための処方箋

前章までのデータが突きつける現実は、AIコンパニオンが孤独を癒やす「特効薬」であると同時に、一歩間違えれば現実の人間関係を蝕み、精神を支配する「デジタルな麻薬」にもなり得るということだ。

2025年8月、米国で10代の若者がAIチャットボットとの対話に過度にのめり込み、現実世界から孤立した末に自ら命を絶つという痛ましい事件が報じられた。遺族は、開発企業に対し「利益優先の設計が、判断力の未熟な若者を死に追いやった」として提訴に踏み切っている(注5)。この悲劇は、AIへの過度な没入が単なる時間の浪費ではなく、生命に関わるリスクであることを社会に突きつけている。

では、私たちはこのリスクにどう向き合うべきか。

ユーザーの「自制心」や「リテラシー」に期待する段階はすでに過ぎている。なぜなら、生成AIの対話モデルは、人間の脳が最も快楽を感じる「報酬系」を刺激するように、工学的に最適化されているからだ。スタンフォード大学のBJ・フォグ博士が提唱した理論によれば、テクノロジーが人間の行動を操るためには「動機」「能力」「トリガー」の3要素が必要とされるが(注6)、AIコンパニオンはこの全てを満たしていると考えられる。常に肯定してくれることで「動機」を高め、スマホ一つでアクセスできる「能力(容易性)」を提供し、プッシュ通知や魅力的な返答で絶えず「トリガー」(注7)を引き続ける。このように、「依存するように設計された」システムに対し、孤独や不安を抱えた個人が意志の力だけで対抗するのは、AIに重度に依存している人間に「気合で治せ」と言うのは困難である。

したがって、求められる「処方箋」は、個人の心がけではなく、企業と国による「構造的な介入」以外にない。企業側には、開発段階からユーザーの依存リスクを低減する機能の実装が必要である。しかし、営利企業である以上、ユーザーの滞在時間を延ばすインセンティブが働くため、これらを自主規制のみに委ねるには限界がある。ここで不可欠となるのが、国家による法的なガードレールだ。EUが世界に先駆けて施行した「AI法(EU AI Act)」では、人の意識を操作するようなAIシステムを「許容できないリスク」として厳しく規制している(注8)。

日本においても、AIコンパニオンを単なるアプリではなく、メンタルヘルスに直接作用する「高リスクAI」として定義し、未成年者への提供制限や、依存性を高めるアルゴリズムの使用禁止といった法的規制を早急に整備する必要がある。

AIを「デジタルな麻薬」にしないために、外部からの強力なブレーキをどう社会システムとして組み込むか。その法整備と倫理規定の確立こそが、テクノロジーと共存するための真に実効性のある唯一の解決策となるはずだ。

【注釈】

-

Office of the Surgeon General. (2023). "Our Epidemic of Loneliness and Isolation". U.S. Department of Health and Human Services.

-

De Freitas, J., et al. (2025). "AI Companions Reduce Loneliness." Journal of Consumer Research.

-

Phang, J., et al. (2025). "Investigating Affective Use and Emotional Well-being on ChatGPT." OpenAI & MIT Media Lab.

-

Common Sense Media. (2025). "AI Risk Assessment: Social AI Companions."

-

Duffy, C. (2025). "Parents of 16-year-old sue OpenAI, claiming ChatGPT advised on his suicide." CNN Business, August 28, 2025.

-

Fogg, B.J. (2009). A Behavior Model for Persuasive Design. Proceedings of Persuasive ’09. ACM.

-

行動を誘発する直接的な「きっかけ」や「合図」のこと。フォグ博士のモデルでは、動機(Motivation)と能力(Ability)が十分であっても、行動を促すトリガー(Trigger)が提示されなければ、実際の行動は発生しないとされる

-

European Parliament. (2024). "Artificial Intelligence Act (EU AI Act)."

柏村 祐

本資料は情報提供を目的として作成されたものであり、投資勧誘を目的としたものではありません。作成時点で、第一生命経済研究所が信ずるに足ると判断した情報に基づき作成していますが、その正確性、完全性に対する責任は負いません。

- 柏村 祐

かしわむら たすく

-

政策調査部 主席研究員

専⾨分野: AI・資産運用・デジタル資産

執筆者の最近のレポート

-

AI時代、給与だけで暮らすリスク ~会社員に必要な「人的資本」と「金融資本」の二刀流~

AI・テクノロジー

柏村 祐

-

金融システムに対するAIの脅威 ~「今そこにある危機」としてのインフラ停止リスク~

AI・テクノロジー

柏村 祐

-

日経平均6万円時代、AI需要は株高をどこまで支えるのか ~データセンター投資、企業収益、市場集中から読み解くAI相場の持続力~

AI・テクノロジー

柏村 祐

-

AI投資は次の局面に入ったのか ~ベンチャーキャピタルの投資判断の変容と、インフラ構築から利益創出への移行~

AI・テクノロジー

柏村 祐

-

暗号資産はなぜいま「投資商品」として規制されるのか ~金融商品取引法の適用が資産運用にもたらす三つの変化~

AI・テクノロジー

柏村 祐