- HOME

- レポート一覧

- ビジネス環境レポート

- フィルターバブルがウェルビーイングに与える影響

- Illuminating Tomorrow

-

2026.02.02

ライフデザイン

SDGs・ESG

コミュニケーション

幸せ・well-being・QOL

持続可能な社会(SDGs)

フィルターバブルがウェルビーイングに与える影響

~心地よさに潜むウェルビーイングの落とし穴~

髙宮 咲妃

- 要旨

-

- フィルターバブルとは、検索やSNS等のアルゴリズムが利用者の行動データに基づき情報をパーソナライズする結果、「見たい情報」が優先的に表示され、「関心のない情報」が遮断されることで、特定の価値観の中に閉じ込められる情報環境を指す。

- フィルターバブルは、①プラットフォームによる順位付け・推薦、②同質的な友人・フォローネットワーク、③利用者自身のクリック選好、の三つの要因の相互作用から生じる自己強化ループである。

- ウェルビーイングとの関係では、同意的で関連性の高い情報が続くと、短期的には安心感・納得感が増す一方で、異なる視点や反証に触れる機会が減ることで、現実の対立や不確実性に直面した際のストレスや混乱が大きくなり得る。

- 同質的なコミュニティは社会的支持を与え、主観的ウェルビーイングを一時的に高めるが、「道徳感情を含む言語」や憤りの表明が社会的報酬(いいね等)によって強化されると、敵意・嘲笑・蔑視が規範化され、攻撃する側・される側双方のメンタルヘルスと長期的ウェルビーイング資源(信頼・関係の質等)を損なうリスクがある。

- 対策として個人側には、反論を含む検索を意図的に行うこと、強い感情反応を覚えた投稿を拡散する際にワンクッション置くこと、通知や連続再生などの環境設定を見直すこと、教育現場で相互理解を促進するファシリテーションを学ぶこと等、セルフ・ガバナンスと家庭・学校における支援の組み合わせが求められる。

- プラットフォーム側には、セレンディピティや多様性をデフォルトに組み込む設計、推薦理由を開示する説明可能性の強化、エンゲージメントだけでなく敵意言語比率等のウェルビーイング関連指標のモニタリングによる安全・品質管理が求められる。併せて政府・社会側にも、利用者が「選べる/戻れる」環境を支える制度整備や情報リテラシー教育の高度化が求められる。

1. フィルターバブルとは

昨今の情報過多の社会において、供給される情報量に対して私たちが割ける消費時間やアテンション(注意)は限られており、両者は希少な資源となっている(注1)。これは50年以上前にSimon(1971)が「情報の豊かさは注意の希少性を生む」と指摘した点である。今日では、デジタル・プラットフォームの普及と最適化がさらに進展したことで、プラットフォーム間で最適化を武器に利用者の滞在時間・反応を競い合うようになった。個々人の可処分注意をめぐる争奪が強まり、「注意の希少化」がより顕在化しやすくなっている。インターネットの検索サービス、SNS、動画共有サイト等のソーシャルメディア・プラットフォームは、利用者から可能な限り多くの消費時間、アテンションを獲得するために、利用者の行動データを収集し、利用者の選好に合わせて検索結果や表示される投稿をパーソナライズ(個別最適化)し、「最も強く反応するもの」を予測することで、エンゲージメント(滞在時間や反応等)の最大化を図っている。

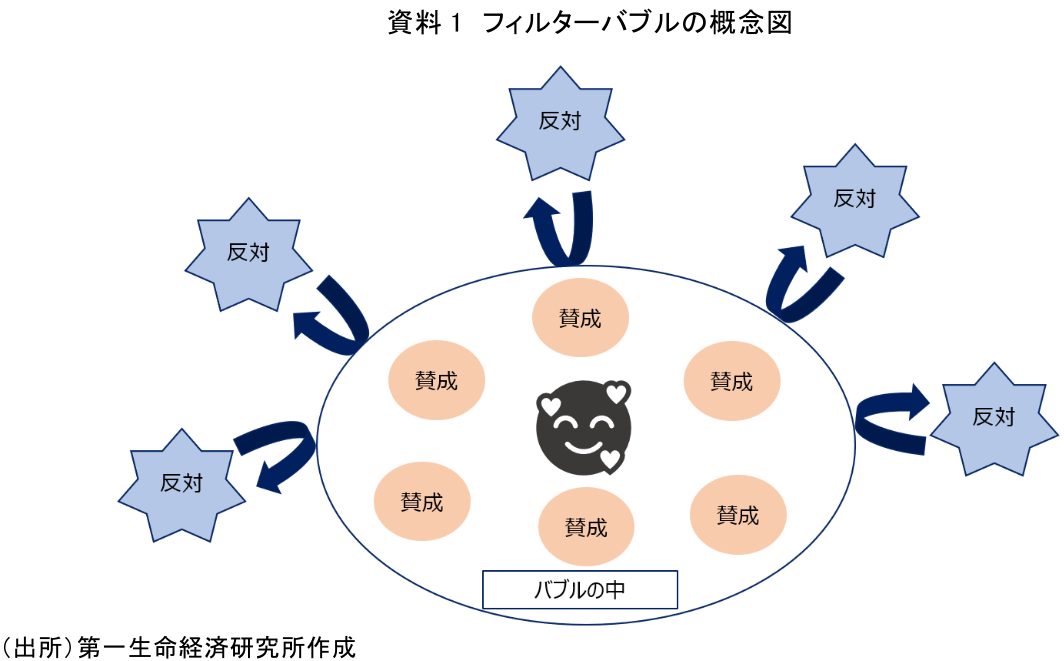

こうしたパーソナライズが進展した情報環境の一つとして、フィルターバブルが議論されている。フィルターバブルとは、パーソナライズされた情報フィルターにより、「見たい情報が優先的に表示される」「関心のない情報が遮断される」環境が構築され、利用者が接する情報に偏りが生じ、自身の考え方や価値観の「バブル(泡)」の中に孤立してしまうという状態を指す(資料1)。

フィルターバブルの特徴は、単に「偏った情報が見える」ことにとどまらない。第一に、偏りがランキングや推薦の仕組みを通じて漸進的に形成されるため、利用者が変化を自覚しにくい。第二に、パーソナライズは通常「自分に関係がある情報が出てくる」「探す手間が減る」という利便性として認識されるため、本人にとって快適な情報環境として受け止められやすい。そのため、結果として情報接触の範囲が狭まっていても気づきにくい(Pariser,2011)。さらに、利用者の反応が学習データとして蓄積されることで、提示内容が一層「本人好み」に最適化され、同種の情報接触が増えるという自己強化ループ(注2)が生じ得る点も重要である。オンラインニュース消費の実証研究は、こうした仕組みが情報接触の偏りと結びつき得ることを示しつつ、影響の大きさや現れ方は利用経路や文脈によって異なるため、一般化には留保が必要であることも示している(Flaxman,Goel & Rao,2016)。

なお、フィルターバブルはしばしばエコーチェンバー(反響室)と併せて議論される。概念整理としては、フィルターバブルが主にアルゴリズムやパーソナライズによる情報提示の偏りを指すのに対し、エコーチェンバーは主に同質的な人間関係(ネットワーク)内で意見が反響・増幅される側面を指すことが多い。ただし実際には、友人ネットワーク・アルゴリズム・本人の選択が相互に作用し得るため、両者を切り離すよりも複合的なプロセスとして捉えるのが適切であるとされている(Bakshy,Messing & Adamic,2015)。これを踏まえ、本稿ではフィルターバブルを「提示の仕組み(ランキング/推薦)による偏り」として主に扱い、エコーチェンバーは「同質的ネットワーク内での増幅」として補助的に位置づけることとする。

2. フィルターバブルはどのようにして生まれるのか

フィルターバブルは単一要因では説明しにくい。大規模SNSデータの研究では、ニュース接触の偏りに対して、主に要因①プラットフォームによる順位付け・推薦、要因②利用者がつながる相手(同質的ネットワーク)からの流入、要因③利用者自身のクリック選好、がそれぞれ寄与し得ることが示されている(Bakshy,Messing & Adamic,2015)。

要因①プラットフォームによる順位付け・推薦について説明すると、プラットフォームは一般に、滞在時間や反応を増やすために推薦・ランキングを個々の利用者向けに最適化する。ここで注意すべきは、最適化の目的が「真実性」や「公共性」ではなく、「視聴される/反応される」指標に置かれがちな点である。

要因②同質的ネットワークからの流入については、そもそも人は似た価値観や関心を持つ相手とつながりやすい。SNS上の関係性が同質化すれば、共有されるニュースや意見も偏りやすくなる。Bakshy et al. (2015) は、友人ネットワークの同質性が、接触する情報の多様性に影響し得ることを示している。

要因③利用者自身のクリック選好については、利用者自身が「見たい情報」を選び、クリック・視聴する。その行動が学習データとなって推薦がさらにパーソナライズされ、同種情報への接触が増える、という自己強化ループが生じ得る。

フィルターバブルが生じる原因は、「アルゴリズムのせい」だけでも「利用者のせい」だけでもない。設計(推薦機能等)×関係(ネットワーク)×選択(行動)の相互作用で生まれる現象である点に留意すべきである。したがって対策も、単一の対策で済ませず、複数の打ち手を組み合わせていくことが重要である。

3. フィルターバブルとウェルビーイング

本章では、フィルターバブル(提示側の偏り)とエコーチェンバー(関係性側の反響)が重なり合うことで、ウェルビーイングにどのような影響が生じ得るかを整理する。本レポートでは、ウェルビーイングを、単なる「気分の良さ」や「生活評価」に限らず、情動の安定(不安・怒り等)、日常生活の機能やストレス対処(メンタルヘルス等)、および他者との関係の質や社会的信頼(信頼・協力・対話可能性等)といった複数の要素から成る多面的概念であると定義する。したがって本稿では、ウェルビーイングを単一のスコアに還元せず、上記の要素がそれぞれどのように影響を受け得るかに着目する。

3-1 認知負荷の低下と、社会に対する理解の単純化

自身の意見と一致する情報(以下、同意的情報)や関連性の高い情報が優先提示されると、情報探索の負荷が下がり、短期的には安心感や納得感が得られやすい。これはウェルビーイングを高め得ると考えられる。一方で、異なる視点や反証に触れる機会が持続的に減少すれば、不確実性の下で前提を更新する機会が減り、現実の対立や曖昧さに直面した際に認知的負荷が跳ね上がり、ストレス反応が強まる可能性がある(Kashdan & Rottenberg,2010)。

3-2 社会的支持の獲得およびエコーチェンバーによる敵意・攻撃性の強化

同質的なコミュニティは「仲間がいる」という社会的支持を提供し得るため、短期的にはウェルビーイングを押し上げる可能性がある。一方で、同質性が強いネットワーク内では、意見や評価が反響・強化されやすい。対立対象への敵意や嘲笑、道徳的憤りの表明が、所属するネットワーク内で賛同されやすい行動として共有され、異論を唱えにくい雰囲気(暗黙の規範)が形成されると、攻撃的言動が正当化されやすくなる可能性がある。この点を裏づける関連研究として、政治的・道徳的話題において「道徳感情(moral-emotional)を含む言語(注3)」がオンラインでの拡散を強めることが示されている(William J.Brady et al.,2017)。さらに、オンライン上では、憤りの表明が「いいね」や共有といった社会的報酬を得やすい場合があり、その社会的報酬が将来の憤り表明を増やす(学習される)ことを示す研究もある(William J.Brady et al.,2021)。結果として、コミュニティ内の一体感は短期的に高まっても、敵対集団や異論者に対する蔑視・嫌悪が強まりやすくなれば、攻撃される側のメンタルヘルスだけでなく、攻撃に参加する側にとっても、慢性的な怒り・不信・警戒といった情動状態が固定化し、長期的なウェルビーイング資源(関係の質、信頼、安定した自己評価)を損ない得ると考えられる。

3-3 共通の現実認識の希薄化による社会的信頼の低下

社会学的には、社会的信頼は相手がどのように振る舞うかについての共有された期待(最低限の共通理解)があって初めて成立し、信頼は社会生活の不確実性を縮減して協力や相互作用を可能にすると整理されている(Lewis & Weigert,1985)。フィルターバブルが進むと、各人が接触する情報環境が分断され、会話が噛み合わない経験が増える可能性がある。これはウェルビーイング(特に信頼・協力・対話可能性等)に影響し得ると考えられる。

以上を踏まえると、フィルターバブルをウェルビーイングの問題として扱う際の要点は、影響が一様にプラス/マイナスと断定できず、時間軸によって変化し得る点にある。短期的には同意的情報に囲まれると認知負荷が下がり、安心感・納得感が増し、ウェルビーイング(特に情動・生活評価等)が高まり得る一方で、長期的には同じ快適性が持続し、多様な視点との「安全な接続」が欠けると、ストレス対処や日常生活の調子(睡眠等)といったメンタルヘルスや、ウェルビーイング(特に信頼・協力・対話可能性等)が損なわれ得る。ただし、影響は個人差・SNS等の使い方・環境要因に依存し、因果推定は複雑であることは留意が必要である(U.S.Surgeon General,2023;APA,2023;WHO Europe,2024)。

したがって対策は、「パーソナライズを止める/多様な情報を浴びせる」といった単純な対策ではなく、短期的な便益を壊しすぎずに長期資源を守るような設計を構築する必要があると考える。

4. 個人、プラットフォーム側での対策の方向性

本章では、①利用者側(個人)のセルフ・ガバナンス、②プラットフォーム側の設計対応を整理する。前章までの議論から明らかなように、フィルターバブルは「便利さ」「心地よさ」と背中合わせであり、対策は「便利さや心地よさを残しながら、偏りと敵意の増幅を抑える」設計でなければ実装されにくい。ここでは、その現実性を担保する形で方向性を提示する。

4-1 利用者側(個人)のセルフ・ガバナンス

フィルターバブルは情報の偏りが徐々に形成されるため、本人が変化を自覚しにくい。したがって利用者側のセルフ・ガバナンスでは、まず「同じ結論の情報ばかりが続き、反対論点や一次情報に触れない」「心地よさや確信だけが増える」といった兆候を点検したうえで、以降の介入につなげることが重要である。

まず、同じテーマでも「反論」「限界」「別の説明」を含む検索を意図的に行い、自己強化ループに小さな切れ目を入れることが肝要となる。自己強化ループへの対応としては、SNS内の情報だけで完結させず、一次資料(統計、公的機関の資料、原典)に戻る導線を意識することも方法の一つである。

続いて、感情反応の増幅に巻き込まれにくくするために、たとえばSNS等で強く反応した投稿ほど、即時拡散せず時間を置く等、拡散前にひと手間(ワンクッション)入れることも対策の一つとなる。ここでのポイントは、個々の利用者の自制心に全面的に依存しないことである。通知設定の見直し、ショート動画の連続自動再生を止める設定、休憩を促すリマインド、利用時間の上限設定(アプリタイマー等)を活用し、「意思の力」ではなく「環境の力」で衝動的な視聴・拡散が起きにくい状態をつくることが有効となり得る。

最後に、自身の「心地よさ」を検知指標にすることも有効な対策となる。いつも快適で確信が強まる環境は、偏りの兆候になり得るが、短期的な便益を享受しつつも、長期の視点で「本当に心地よい状態かどうか」を自己点検し、必要であればSNS等から距離を置く、パーソナライズをリセットする等の行動も考えられる。

また、SNS等の利用者の低年齢化も進んでいるため、通知設定等の個人の工夫だけでは対応しきれない局面もある。実際、諸外国では「未成年の安全確保」を個人の自助努力に委ねず、プラットフォーム側に設計・運用上の責務を求める方向で制度整備が進んでいる。例えば、オーストラリアでは、Online Safety Amendment (Social Media Minimum Age) Act 2024により、一定のSNS等について16歳未満のアカウント保有を防ぐため、事業者が「合理的な手段(reasonable steps)」を講じることが求められる枠組みが導入されている。未成年は情報環境の影響を受けやすく、機能設定や表示の意図を見抜く力も発達段階に依存するため、設計側の保護と並行して、使い方そのものを学ぶ機会が欠かせない。そこで、セルフ・ガバナンスを個人の努力にのみ委ねるのではなく、家庭・学校における支援(教育的アプローチ)も必要だ。とりわけ「安全な異質性(注4)」の訓練として、勝敗を競うディベート型の議論ではなく、前提の違いを言語化し相互理解を促進するファシリテーションを学習機会として組み込むことは、分断の抑制だけでなく、対人関係や市民性といったウェルビーイング資源の形成にも資する。

4-2 プラットフォーム側の設計対応

利用者個人のセルフ・ガバナンスには限界があり、推薦システムの最適化は、個々の利用者が完全に達成できるものではない。したがって推薦・ランキング等の設計主体であるプラットフォーム側においては、エンゲージメント指標を中心に据えた最適化を緩めつつ、ウェルビーイング資源を守る観点を取り入れることが重要となる。以下では、考えられる対応策を4点提示する。

(1)セレンディピティと多様性をデフォルトとして組み込む

ここでいうセレンディピティとは、利用者の現在の関心にぴったり合う情報だけでなく、関心の周縁にある有益な情報や異なる視点にも、推薦の中で偶発的に出会える状態をすることを指す。多様な情報(動画)に触れられる機能を実装しても、それが「見たい人だけが選ぶオプション」だと、同質的環境にとどまりがちな利用者ほど選択しにくく、結果として多様性は確保されにくい。そもそも利用者の関心はデフォルトの推薦機能によって形成されることもある。このため、利用者任せにすると、結果的に同質性が固定化しやすい。そこで、推薦・ランキングの設計においては、次のような「弱い多様性注入」を既定値として組み込むことが考えられる。

これらは、利用者の現在の選好に完全一致する情報だけで推薦を埋め尽くすのではなく、関心の周縁にある有益な情報との偶発的な出会い(セレンディピティ)を、推薦の既定値として確保するための設計である。

ここで重要なのは、目的を「反対意見を見せる」ことに置かないことである。反対意見は時に防衛反応を強め、怒りの材料にもなる。狙いは、異論を投入することではなく、「異なる意見を言う相手が何を前提にそう言うのかが分かる状態」をつくることである。そのためには、①で述べたように同一トピック内で多視点を提示し、③のように対立が生じやすいテーマについて争点構造の可視化や背景・一次データ・用語定義など対立の前提を整理する「橋渡しコンテンツ」を推薦上で優遇することが有効である。ウェルビーイングの観点からは、対立構造を無くす設計よりも、対立があっても対話可能性が失われないような環境を整えることに意味がある。

ただし、こうした「新しい視点との出会い」がなぜ起きたのかは利用者に見えにくい。したがって次項では、推薦理由を理解可能にする仕組み(説明可能性)について扱う。

(2)説明可能性(Why this)を強化する

フィルターバブルの厄介さは、推薦機能による情報の偏りが徐々に形成され、本人が気づきにくい点にある。したがって、推薦・ランキングの「説明可能性」を高めることは、利用者のメタ認知(自分が何に影響されているかを把握する力)を補助することになるだろう。たとえば、「なぜこれが表示されたのか(Why this)」を、理解できる粒度で示す(例:直近の閲覧テーマ、フォロー関係、居住地域、人気度等の寄与)ことが考えられる。さらに、推薦は利用者の過去のクリック・視聴といった行動ログを学習して作られるが、これが「一度見ただけ」「誤って見た」「関心が変わった」等の理由で現在の関心を正しく反映しないこともある。そこで、推定された興味の根拠を利用者自身が修正(興味なしの指定、学習のリセット等)できるようにする。利用者のウェルビーイングを守る観点では、「透明性」それ自体よりも、偏りの自己点検が可能になることが重要となる。

(3)利用者が実際にコントロールできる環境にする(選べる状態ではなく、選びやすい状態)

利用者が個々に表示基準(おすすめ/時系列等)を選べる機能が実装されていたとしても、その切り替え動線が分かりにくく、操作に手間がかかるのであれば、実際に機能しているとはいえない。そこで、利用者コントロールは「選べる」ではなく「選びやすい」設計へ移す必要があると考える。

たとえば、モード選択で「おすすめ(パーソナライズ)」「時系列」「編集方針に基づく一般ランキング」など、複数モードをワンタップで切り替えられるようにする設計や、パーソナライズのリセット/調整機能を実装し、興味推定の消去、一定期間の学習停止等を、少ない手順で分かりやすく操作できるようにする等が考えられる。

(4)ウェルビーイング指標を「安全・品質」の一部として取り入れる

最後に、プラットフォーム側が利用者にコンテンツを推奨する際に、ウェルビーイングの観点を取り入れることも考えられる。

現状のエンゲージメント指標(滞在時間、クリック率、共有数等)(注5)は、怒り・嘲笑のような強い刺激と相性がよく、William J. Brady et al.(2017,2021)が示すように道徳感情や憤りの拡散を後押しする恐れがある。そこで、例えば「短期反応」だけではなく「事後評価」を取り入れたり(具体的には、直後のクリックではなく、一定時間後の「役に立った」「理解が深まった」「後悔が少ない」等の指標を組み合わせるなど)、同質性の強まり、政治的・社会的話題における敵意言語の比率、誤情報に触れた利用者のうち正しい情報まで見た人の割合等、ウェルビーイングに関係する副作用指標を安全管理の一部としてモニタリングする等の対応が考えられる。事後評価については、全利用者から恒常的に回収するのは現実的でないため、表示頻度を抑えつつ、利用者をランダムに抽出して、アプリ内で数秒で回答できる短時間アンケート(マイクロサーベイ)として回収し、回答負担を最小化したうえで推薦モデルに反映する設計などが考えられる。

安全・品質管理の枠組みの中で、上記のような複数の「ウェルビーイングを害する兆候」を監視し、改善サイクルを回すことで、設計上のウェルビーイングへの負の影響を着実に減らしていくことは可能なのではないか。

近年、プラットフォーム各社では、安全・品質の観点を取り入れ、エンゲージメント指標を中心に据えた最適化を一定程度緩めようとする取組みが進みつつある。とりわけEUでは、デジタルサービス法(DSA)により、推薦システムの主要パラメータの説明(なぜそれが提示されるのか等)や、閲覧履歴等の個人データに基づかない推薦(非パーソナライズ)オプションの提供が制度として求められており、利用者は時系列等のアルゴリズム推薦以外の基準を選べる方向で環境整備が進んでいる。

ただし、これらの取組みがどの程度実効的に機能しているか、また事業者のコミットメントが十分かは一様ではなく、今後も継続的な検証が必要である。

5. まとめ

本稿では、フィルターバブルをウェルビーイングの観点から再整理し、それに対応する対策を提示した。留意すべきはフィルターバブル対策が「正しさの押しつけ」になった瞬間に逆効果になり得る点である。ウェルビーイングの立場からは、目指すべきは同質性の否定ではなく、同質性があっても社会が壊れない「回復可能な対話環境」の構築である。短期的な快適さを否定するのではなく、快適さが過度に固定化しないよう、個人とシステムの双方に「戻れる設計」を取り入れることが重要になってくるだろう。

加えて、フィルターバブルの影響は、個人のセルフ・ガバナンスだけでも、企業側の自助努力だけでも十分に制御しきれない。政府・自治体を含む公共部門や、学校教育、研究コミュニティ、メディア等の社会側も、利用者が「選べる/戻れる」環境を実装するための制度整備や、情報リテラシー教育の高度化(「安全な異質性」に基づく対話・前提整理の学習機会の整備等)等を通じて、対話可能性や信頼といったウェルビーイング資源を守ることが求められる。

【注釈】

-

このような人々の注意や時間を希少な資源とみなし、それをめぐって企業・サービスが競争する経済原理のことをアテンション・エコノミーと呼ぶ。

-

自己強化ループとは、利用者のクリック・視聴・滞在などの反応が推薦アルゴリズムの学習データとなり、同種の情報がより優先的に提示され、結果として同種情報への接触が増える循環を指す。

-

William J.Brady et al.(2017)がいう「道徳的な感情を含む言語」とは、道徳的評価(善悪・正邪・義務など)に関わる語と、感情語(怒り・嫌悪など)が同時に含まれる表現を指す。研究では、道徳語彙と感情語彙の2つの辞書(単語リスト)を用い、両方に該当する語(例:hate)の出現を指標化している。日本語では、例えば「許せない」「卑劣だ」「最低だ」といった、非難(善悪の判定)と感情を同時に含む表現が該当する。

-

安全な異質性とは、異なる価値観や意見に触れることを避けるのではなく、心理的安全性を確保しつつ、前提の違いを言語化し相互理解へつなげるために設計された、いわゆる異質との接触を指す。ここでの「安全」とは「対立がない」ことではなく、攻撃・羞恥・排除によって対話可能性が損なわれない条件が整っていることを意味する。

-

エンゲージメント指標とは、プラットフォーム上で利用者がコンテンツにどの程度「関与したか」を、行動ログから定量化した指標群を指す。具体例として、文中で例示した滞在時間、クリック率、共有数のほか、視聴完了率、いいね、コメント、フォロー/購読、再訪率等が含まれる。

【参考文献】

- キャス・サンスティーン(2003)「インターネットは民主主義の敵か」

- 髙宮 咲妃(2025)「フィルターバブルとは?」

- APA (2023)“Health advisory on social media use in adolescence”

- Bakshy, E., Messing, S., & Adamic, L. A. (2015)“Exposure to ideologically diverse news and opinion on Facebook”

- Flaxman, S., Goel, S., & Rao, J. M. (2016)“Filter Bubbles, Echo Chambers, and Online News Consumption”

- Kashdan & Rottenberg (2010) “Psychological flexibility as a fundamental aspect of health”

- Lewis, J. D., & Weigert, A. (1985) “Trust as a Social Reality”

- OECD (2025)“OECD Guidelines on Measuring Subjective Well-being: 2025 update (Second edition) ”

- Pariser, E. (2011)“The Filter Bubble: What the Internet Is Hiding from You”

- Simon, H. A. (1971) “Designing Organizations for an Information-Rich World”

- U.S. Surgeon General (2023)“Social Media and Youth Mental Health: The U.S. Surgeon General’s Advisory”

- WHO / WHO Europe (2024)“Teens, screens and mental health”

- William J. Brady , Julian A. Wills, John T. Jost, Joshua A. Tucker, and Jay J. Van Bavel (2017)“Emotion shapes the diffusion of moralized content in social networks”

- William J. Brady, Killian McLoughlin, Tuan N. Doan, Molly J. Crockett (2021)“How social learning amplifies moral outrage expression in online social networks”

髙宮 咲妃

本資料は情報提供を目的として作成されたものであり、投資勧誘を目的としたものではありません。作成時点で、第一生命経済研究所が信ずるに足ると判断した情報に基づき作成していますが、その正確性、完全性に対する責任は負いません。